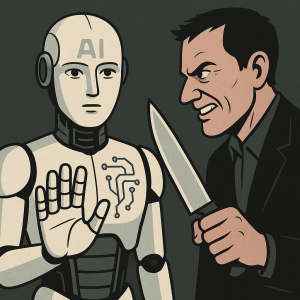

Faut il s’inquiéter de l’Intelligence Artificielle ou de ceux qui y ont recours ?

L’IA en elle-même n’est pas « dangereuse »

C’est un outil. Comme un couteau ou une voiture : elle ne pense pas, elle n’a pas de volonté propre. Elle fait ce qu’on lui demande de faire, selon les instructions et les données qu’on lui donne.

👉 Ce qui peut être dangereux, ce sont les usages qu’on en fait

- Mauvaise intention : des personnes peuvent utiliser l’IA pour manipuler l’opinion (deepfakes, fake news), pirater des systèmes, ou surveiller de façon abusive.

- Incompétence ou négligence : une IA mal conçue ou mal entraînée peut prendre des décisions injustes (ex : dans le recrutement ou la justice), ou causer des accidents (ex : voiture autonome mal calibrée).

- Absence de régulation : si l’IA est utilisée sans contrôle, elle peut amplifier les inégalités ou automatiser des décisions critiques sans transparence.

👉 Mais il y a aussi des risques propres à l’IA

Même si personne n’a de mauvaises intentions, certaines IA peuvent devenir dangereuses par effet de complexité, de biais cachés ou d’émergence (c’est-à-dire des comportements inattendus qui surgissent quand un système devient très avancé).

Donc en résumé :

📌 Ce ne sont pas les IA qui sont dangereuses en elles-mêmes, mais leur conception, leur utilisation, et l’absence de garde- fous.

Mais plus elles deviennent puissantes, plus on a intérêt à les encadrer sérieusement.

Nota : Vous avez la réponse de ChapGPT à qui nous avons a posé cette question et à qui nous avons demandé de fournir l’image d’illustration de l’article.